IA et analyse prédictive : comment anticiper les tendances avant que le marché ne les valide

Article : IA et analyse prédictive pour anticiper les tendances marketing

L’analyse prédictive IA désigne l’utilisation de modèles d’apprentissage automatique pour détecter des régularités dans des données passées et en déduire des comportements futurs. Appliquée au marketing, elle permet d’anticiper la demande, d’identifier les tendances émergentes et d’ajuster les stratégies de contenu avant que le marché ne confirme ce que les données avaient déjà signalé.

En clair : les marques qui maîtrisent cet outil ne réagissent plus. Elles précèdent.

Pourquoi l’analyse prédictive change réellement les règles du jeu

La plupart des stratégies marketing sont encore construites sur du rétroviseur. On analyse ce qui a fonctionné, on reproduit, on ajuste. C’est une logique de gestion du risque à court terme. Pas une logique de croissance.

L’analyse prédictive IA inverse ce rapport au temps. Elle ne décrit pas ce qui s’est passé elle modélise ce qui va se passer.

Selon une étude McKinsey (2023), les entreprises qui intègrent des outils d’IA prédictive dans leur processus marketing constatent une augmentation de 15 à 20 % de leur ROI sur les campagnes de contenu. Pas parce qu’elles ont mieux exécuté. Parce qu’elles ont mieux ciblé, mieux timé, mieux alloué.

La différence entre une marque qui subit les tendances et une marque qui les surfe tient souvent à quelques semaines d’avance. C’est précisément ce que rend possible une bonne infrastructure prédictive.

Ce que l’IA détecte que l’intuition manque systématiquement

L’intuition marketing est utile. Elle reste insuffisante à grande échelle.

Un signal faible sur TikTok une micro-tendance, un vocabulaire naissant, un type de format qui commence à surperformer a une durée de vie courte avant d’être saturé. Le délai moyen entre l’émergence d’une tendance sur les réseaux et son adoption mainstream est aujourd’hui estimé à 3 à 6 semaines (Trendwatching, 2024). Une équipe créative qui attend de voir avant d’agir arrive toujours trop tard.

Les modèles prédictifs, eux, traitent en continu des volumes de données que l’humain ne peut pas absorber : historiques d’achats, comportements de navigation, volumes de recherche, dynamiques conversationnelles sur les réseaux, corrélations saisonnières. Ils détectent des patterns invisibles à l’œil nu.

Ce n’est pas de la magie. C’est de la puissance de calcul mise au service de décisions mieux informées.

Les applications concrètes en production de contenu et en stratégie de marque

L’analyse prédictive IA n’est pas réservée aux directions data des grands groupes. Elle est aujourd’hui opérationnelle dans des contextes de production accessibles aux TPE et PME en croissance.

Prévision des formats qui vont performer. En croisant des données de consommation de contenu avec des tendances de plateforme, il est possible d’identifier les formats qui vont gagner en traction avant qu’ils ne deviennent évidents.

Détection des micro-tendances éditoriales. Des outils comme Google Trends couplé à BigQuery, ou Black Swan Data, permettent de repérer les glissements sémantiques et d’orienter la production éditoriale en conséquence.

Segmentation dynamique. L’IA prédictive ne fige pas les audiences. Elle les modélise en mouvement, identifiant les segments qui vont prendre de la valeur avant qu’ils ne soient saturés par la concurrence.

Optimisation du timing de diffusion. La bonne idée au mauvais moment n’a aucune valeur. Les modèles prédictifs permettent de déterminer les fenêtres d’attention maximale par segment, par plateforme, par type de contenu.

Les outils qui méritent vraiment l’attention

Tous les outils ne se valent pas. Voici ceux qui offrent un rapport pertinence/accessibilité solide pour une structure en croissance.

Google Trends + BigQuery Pour analyser en temps réel les évolutions de volume de recherche et détecter des corrélations inattendues. Gratuit et sous-exploité.

Salesforce Einstein Analytics Intégration native de l’IA prédictive dans le CRM. Selon le State of Marketing de Salesforce (2024), 71 % des équipes marketing les plus performantes utilisent désormais des outils d’IA prédictive dans leur stack.

Pecan AI Une plateforme d’analytique prédictive pensée pour les équipes sans compétences data pointues. Produit des modèles exploitables sans nécessiter de data scientist en interne.

Black Swan Data Spécialisée dans la détection de tendances en amont pour les marchés FMCG et lifestyle.

Un point important : la performance de ces outils dépend entièrement de la qualité des données en entrée. La rigueur en amont n’est pas optionnelle.

Ce que l’analyse prédictive ne remplace pas

L’IA prédictive modélise des probabilités. Elle ne tranche pas.

Elle peut identifier qu’un segment d’audience va probablement réagir positivement à un contenu immersif court dans les six prochaines semaines. Elle ne sait pas si ce contenu doit être tourné en studio, en décor réel, avec un porte-parole ou en avatar de marque. C’est là que la direction créative reprend la main.

Il y a aussi la question des biais algorithmiques. Un modèle entraîné sur des données historiques reproduit mécaniquement les patterns du passé. L’interprétation humaine n’est pas un supplément. C’est une nécessité.

Enfin, les consommateurs ne sont pas indifférents à la façon dont leurs données sont utilisées. Transparence et pertinence ne sont pas contradictoires. Elles se renforcent mutuellement.

Le point de vue Infuse-IA

Chez Infuse-IA, nous considérons que l’analyse prédictive n’a de valeur que si elle est connectée à la capacité de produire rapidement ce qu’elle révèle.

Détecter une tendance six semaines à l’avance n’est un avantage que si on peut passer en production dans ce délai. C’est précisément ce que permet une approche hybride intelligence de production et direction créative combinées qui réduit les cycles de validation et maintient la cohérence de marque même sous pression temporelle.

L’IA prédictive dit quoi faire. La production hybride permet de le faire au bon moment, avec le bon niveau de qualité.

FAQ IA et analyse prédictive en marketing

Qu’est-ce que l’analyse prédictive IA en marketing ?

L’analyse prédictive IA consiste à utiliser des algorithmes d’apprentissage automatique pour analyser des données passées comportements d’achat, tendances de recherche, interactions sociales et anticiper des comportements futurs. En marketing, elle permet d’orienter les décisions de contenu, de budget et de timing avant que les tendances ne soient visibles à l’œil nu.

L’analyse prédictive est-elle accessible aux PME, ou réservée aux grands groupes ?

Elle est aujourd’hui accessible à des structures de taille intermédiaire. Des outils comme Pecan AI, Google Trends couplé à BigQuery ou Salesforce Einstein permettent de mettre en œuvre des modèles prédictifs sans infrastructure data lourde ni équipe de data scientists dédiée. Le vrai prérequis, c’est la qualité et la cohérence des données en entrée.

Quels sont les risques réels d’une mauvaise utilisation de l’IA prédictive ?

Trois risques principaux : des données sources incomplètes ou biaisées qui produisent des projections faussement fiables ; des biais algorithmiques qui reproduisent et amplifient des patterns discriminatoires ; et une sur-dépendance aux projections qui élimine le jugement créatif. L’IA prédictive est un outil d’aide à la décision pas un substitut à la décision.

Comment l’analyse prédictive s’intègre-t-elle dans une stratégie de contenu ?

Elle intervient en amont de la production : en identifiant les formats, les angles éditoriaux et les fenêtres de diffusion qui ont la plus forte probabilité de performance. Elle peut aussi être utilisée en continu pour ajuster les messages en cours de campagne selon les signaux de réaction des audiences.

Quelle différence entre analyse prédictive et analyse descriptive ?

L’analyse descriptive répond à la question « que s’est-il passé ? ». L’analyse prédictive répond à « que va-t-il probablement se passer ? ». La première est utile pour le reporting. La seconde est utile pour la stratégie. Les deux sont complémentaires, mais seule la prédictive permet d’agir avant que le marché ne valide ce que les données signalaient déjà.

SEO conversationnel : comment optimiser ses contenus pour les moteurs IA et la recherche vocale

IA et SEO conversationnel : optimiser son contenu à l’ère des moteurs de recherche intelligents

Le SEO conversationnel désigne l’ensemble des pratiques d’optimisation visant à rendre un contenu interprétable et citable par les moteurs de recherche basés sur l’IA ChatGPT, Perplexity, Google SGE ainsi que par les assistants vocaux. L’objectif est de structurer l’information de manière à ce qu’un modèle de langage puisse l’extraire, la reformuler et la restituer directement à l’utilisateur, sans que celui-ci n’ait à cliquer.

Ce n’est plus une question de positionnement. C’est une question de citabilité.

Pourquoi le SEO tel qu’on le pratiquait ne suffit plus

Pendant vingt ans, le SEO a fonctionné sur un principe simple : placer le bon mot-clé au bon endroit pour que Google comprenne de quoi parle la page. L’utilisateur cherchait, Google listait, l’utilisateur cliquait.

Ce modèle est en train de se désagréger. Selon BrightEdge (2024), près de 60 % des requêtes Google aux États-Unis aboutissent aujourd’hui à une réponse directe générée par IA sans clic sur un site tiers. En France, la dynamique est identique, avec une accélération sensible depuis le déploiement de Google AI Overviews en 2024.

L’enjeu n’est plus seulement d’être visible dans les résultats. C’est d’être la source que le moteur choisit de citer.

Gartner prévoit qu’en 2026, le trafic organique traditionnel aura diminué de 25 % pour les marques qui n’auront pas adapté leur stratégie de contenu aux moteurs génératifs (Gartner, 2024). Ce n’est pas une projection lointaine. C’est dans douze mois.

Ce que les moteurs IA cherchent réellement dans un contenu

Les modèles de langage ne lisent pas un article comme un humain. Ils découpent le texte en blocs, évaluent la densité informationnelle de chaque bloc et sélectionnent ceux qui répondent le mieux à une intention précise.

Quatre critères dominent cette sélection.

La réponse directe en ouverture. Un contenu qui définit son sujet dans les 60 premiers mots est significativement plus souvent cité qu’un contenu qui construit une mise en contexte avant de répondre.

La structure hiérarchique lisible. H1, H2, H3 qui répondent à des intentions de recherche réelles pas des titres de section génériques. Les moteurs IA utilisent cette hiérarchie pour naviguer dans le document et extraire des blocs pertinents.

La densité factuelle. Les données chiffrées, les sources nommées, les exemples concrets augmentent le score de fiabilité d’un contenu aux yeux des LLM. Une affirmation non étayée a moins de chances d’être reprise qu’une affirmation avec une référence identifiable.

Le format Q&A. Le format question-réponse est le plus cité par les moteurs génératifs. Une FAQ bien construite, avec des réponses autonomes hors contexte, constitue l’un des leviers les plus efficaces du SEO conversationnel.

Les techniques qui font réellement la différence

Le SEO conversationnel se joue sur plusieurs niveaux simultanément. Les pratiques ci-dessous ne sont pas des conseils génériques ce sont les leviers identifiés comme déterminants dans les études sur la citatibilité des contenus par les LLM.

Répondre à l’intention, pas au mot-clé

Un utilisateur qui tape « agence vidéo IA Lyon » ne cherche pas une définition. Il cherche à comprendre ce qu’il va obtenir, combien ça coûte et pourquoi choisir telle structure plutôt qu’une autre. Un contenu optimisé répond à ces trois questions implicites, pas seulement à la requête de surface.

Outils utiles pour cartographier les intentions réelles : AnswerThePublic, AlsoAsked, et la fonctionnalité « People Also Ask » de Google Search Console.

Travailler la longue traîne conversationnelle

Les requêtes vocales et conversationnelles sont structurellement plus longues que les requêtes texâtuelles classiques. Plutôt que « production vidéo IA », on voit apparaître « comment produire une vidéo de marque avec un avatar IA sans tourner ? ». Ce type de requête de longue traîne conversationnelle est moins concurrentiel et plus qualifié.

L’enjeu est d’intégrer ces formulations naturellement dans les contenus dans les H2, dans les introductions, dans les FAQ. Pas de la suroptimisation. De la pertinence.

Structurer avec des données enrichies (Schema.org)

Le balisage Schema.org permet aux moteurs IA de comprendre la nature du contenu sans avoir à l’interpréter. Un FAQ Page bien balisé augmente la probabilité d’apparition en position zéro (featured snippet) et dans les réponses directes des assistants vocaux.

Selon une analyse de Google (2024), les pages utilisant des données structurées correctement implémentées ont 2 fois plus de chances d’apparaître dans les résultats enrichis. Sur Squarespace, l’implémentation se fait via les paramètres SEO de chaque page ou par injection de JSON-LD dans le code.

Créer du contenu qui résiste à l’extraction

Un bloc de texte citable par un LLM doit remplir trois conditions : être autonome (compréhensible sans le reste de l’article), factuel (données ou exemples vérifiables), et dense (répondre à une question précise en moins de 200 mots).

C’est exactement la logique du paragraphe d’ouverture d’un article bien construit : définition + réponse directe + valeur ajoutée immédiate.

Les outils qui aident concrètement

Le SEO conversationnel ne nécessite pas un stack technique complexe. Ces quatre outils couvrent l’essentiel pour une structure en croissance.

AnswerThePublic / AlsoAsked Pour cartographier les vraies questions posées par les internautes autour d’une thématique. Indispensable pour construire une FAQ pertinente.

Semrush / Ahrefs Pour identifier les mots-clés longue traîne conversationnels et analyser les intentions de recherche par volume et difficulté.

Google Search Console Pour surveiller les requêtes naturelles qui génèrent déjà du trafic et identifier les opportunités d’optimisation conversationnelle sur des contenus existants.

ChatGPT / Perplexity Pour tester directement la visibilité de ses contenus. Poser à ces moteurs les questions que se pose votre cible permet de vérifier si votre marque apparaît dans les réponses générées.

Ce que le SEO conversationnel ne règle pas seul

L’optimisation technique est nécessaire. Elle n’est pas suffisante.

Les moteurs IA appliquent des filtres de confiance. Une source bien structurée mais pauvre en expertise réelle sera déclassée face à une source moins bien balisée mais plus informative. L’autorité perçue E-E-A-T dans le vocabulaire Google reste le facteur discriminant à long terme.

Il y a aussi la question de la différenciation. Les LLM ont tendance à synthétiser les contenus convergents. Un article qui dit la même chose que les dix premiers résultats existants a peu de chances d’être cité plutôt qu’eux. Ce qui génère de la citatibilité, c’est l’information gain apporter quelque chose que les sources existantes ne contiennent pas.

Le SEO conversationnel n’est pas une technique de remplissage. C’est une discipline d’exigence.

Le point de vue Infuse-IA

Chez Infuse-IA, nous considérons que le SEO conversationnel et la production de contenu hybride sont deux faces d’un même problème.

Un contenu qui répond aux exigences des moteurs IA doit être dense, structuré, expert et différencié. C’est exactement ce que notre approche hybride produit : une direction créative humaine qui définit l’angle, le point de vue et l’information gain et une intelligence de production qui assure la structure, la cohérence formelle et la cadence.

Produire pour être cité par les LLM, ce n’est pas optimiser mécaniquement. C’est écrire avec plus d’exigence qu’avant.

FAQ SEO conversationnel et moteurs IA

Qu’est-ce que le SEO conversationnel ?

Le SEO conversationnel désigne l’ensemble des pratiques d’optimisation visant à rendre un contenu interprétable et citable par les moteurs de recherche basés sur l’IA (Google SGE, ChatGPT, Perplexity) et par les assistants vocaux. Il s’appuie sur une structure claire, une réponse directe en ouverture, des données factuelles et un format Q&A systématisé.

Quelle différence entre SEO classique et SEO conversationnel ?

Le SEO classique optimise un contenu pour qu’il apparaîsse dans la liste des résultats d’un moteur de recherche. Le SEO conversationnel optimise un contenu pour qu’il soit sélectionné et cité directement par un moteur génératif comme réponse à une question, sans nécessiter de clic. Les critères déterminants passent du positionnement par mot-clé à la citatibilité par les LLM.

Quels types de contenus sont les plus cités par les moteurs IA ?

Les contenus structurés en format Q&A (question-réponse) sont les plus fréquemment cités par les LLM. Viennent ensuite les définitions courtes et précises, les listes numérotées, et les paragraphes courts à forte densité informationnelle. Les textes longs et non structurés, quelle que soit leur qualité rédactionnelle, sont moins souvent sélectionnés.

Comment savoir si mon contenu est visible dans les réponses des moteurs IA ?

La méthode la plus directe consiste à poser à ChatGPT, Perplexity ou Google AI Overviews les questions que se pose votre cible, et à vérifier si votre marque ou vos contenus apparaîssent dans les réponses générées. Google Search Console permet également de surveiller les requêtes naturelles qui génèrent déjà des impressions sur vos pages.

Le SEO conversationnel remplace-t-il le SEO traditionnel ?

Non. Les deux sont complémentaires. Le SEO traditionnel reste pertinent pour le trafic organique sur requête courte et pour les intentions d’achat directes. Le SEO conversationnel prend le relais sur les requêtes informées, les questions complexes

et la recherche vocale. Les marques les plus performantes en 2025 sont celles qui maîtrisent les deux niveaux simultanément.

Influenceurs virtuels créés par IA : ce qu’ils changent vraiment pour les marques

Influenceurs virtuels IA

Un influenceur virtuel est un personnage numérique généré par IA, doté d’une identité visuelle et narrative construite, qui produit du contenu sur les réseaux sociaux, interagit avec une communauté et collabore avec des marques exactement comme le ferait un créateur humain. La différence : son apparence, son discours, ses valeurs et ses prises de position sont entièrement maîtrisés par ceux qui le créent. Aucune dérive, aucun bad buzz imprévu, aucune négociation tarifaire post-signature.

C’est la raison pour laquelle des marques comme Prada, Dior ou BMW ont déjà choisi cette voie. Pas par fascination technologique. Par exigence stratégique.

Un marché qui est passé du phénomène à la réalité commerciale

Les influenceurs virtuels ne sont plus une curiosité de technophiles. Ils sont devenus un segment mesurable et en croissance rapide de l’écosystème de l’influence marketing.

Selon Business Insider Intelligence (2024), le marché mondial des influenceurs virtuels est estimé à 37 milliards de dollars d’ici 2025, soit une croissance de plus de 40 % en deux ans. Lil Miquela, avatar américain créé par le studio Brud en 2016, comptait plus de 2,5 millions d’abonnés sur Instagram et des collaborations avec Prada et Calvin Klein avant ses concurrents humains les plus installés.

Ce qui est encore plus révélateur : selon HypeAuditor (2024), les influenceurs virtuels génèrent en moyenne 3 fois plus d’engagement que leurs équivalents humains à taille de communauté comparable. L’audience ne se demande pas si le personnage est “réel”. Elle répond à la cohérence et à la qualité narrative du personnage.

Ce n’est pas un effet de mode. C’est une reconfiguration durable des codes de l’influence.

Ce qu’un influenceur virtuel offre qu’un influenceur humain ne peut pas garantir

La question n’est pas de savoir si l’influenceur virtuel est “mieux” qu’un influenceur humain. La question est de savoir ce qu’il règle structurellement.

Contrôle total de l’image de marque. L’avatar incarne exactement les valeurs définies en amont ton, posture, universe stylé, prises de position. Aucun écart non anticipé.

Zéro risque réputationnel. Un influenceur humain peut changer d’opinion, avoir un comportement problématique ou se retrouver au cœur d’une controverse. Un avatar de marque, non.

Disponibilité permanente et échelle mondiale. Publier 24/7, dans plusieurs langues, sur plusieurs marchés simultanément. Avec une cohérence visuelle et narrative inalterabée.

Évolutivité créative. Un influenceur virtuel peut apparaître dans un décor impossible, porter une collection avant qu’elle existe en physique, ou être décliné dans des univers visuels très différents sans contrainte logistique.

Maîtrise budgétaire sur la durée. Le coût d’un avatar de marque bien construit est inférieur à celui d’un partenariat long terme avec une célébrité, dès lors que les assets sont mutualisés et les process de production maîtrisés.

Les cas qui démontrent que ça fonctionne à grande échelle

Les exemples existants ne sont pas des expériences de laboratoire. Ce sont des actifs commerciaux avec des audiences réelles et des résultats mesurables.

Lil Miquela Brud / États-Unis

Créée en 2016 par le studio Brud, Lil Miquela a dépassé les 2,5 millions d’abonnés Instagram avec des collaborations officielles avec Prada, Calvin Klein et Samsung. Son positionnement : jeune adulte engagée, brasée, intéressée par la musique et la mode. Sa force : une narration assez cohérente pour générer une vraie identification communautaire.

Lu do Magalu Magazine Luiza / Brésil

Lancée par le retailer Magazine Luiza, Lu do Magalu a atteint plus de 15 millions d’abonnés cumulés sur l’ensemble de ses plateformes. Elle présente des produits, interagit avec les clients, prend position sur des causes sociales. C’est l’exemple le plus abouti d’intégration d’un avatar de marque comme interface relationnelle principale avec une audience.

Noonoouri Joerg Zuber / Allemagne

Influenceuse fashion virtuelle allemande, Noonoouri a collaboré avec Dior, Versace et Kim Kardashian's SKIMS. Sa singularité : une esthétique délibérément stylisée, presque manga, qui ne cherche pas à tromper sur sa nature artificielle mais à en faire un code stylistique à part entière.

Les technologies qui rendent cela possible aujourd’hui

La création d’un influenceur virtuel crédible repose sur une combinaison de briques technologiques qui ont toutes franchi un seuil de maturité décisif ces deux dernières années.

Modélisation 3D et animation. Blender, Unreal Engine, Maya permettent de créer des avatars à niveau de réalisme photoconvainquant ou d’adopter des esthétiques très construites selon le positionnement de marque.

IA générative visuelle. MidJourney, Stable Diffusion, Flux permettent de décliner rapidement des univers visuels, des décors, des tenues et des mises en scène sans tourner une seule image en conditions réelles.

IA vocale. ElevenLabs, Resemble.ai permettent de doter l’avatar d’une voix personnalisée, stable, multilingue, adaptée au format (story, réel, podcast court).

IA conversationnelle. Les modèles de langage permettent d’animer les interactions avec la communauté à grande échelle commentaires, messages directs, Q&A avec cohérence narrative.

Ce que les marques sous-estiment en se lançant trop vite

Un influenceur virtuel mal construit fait plus de tort qu’un mauvais choix d’influenceur humain. Parce qu’il engage directement l’image de la marque, sans la distance qu’offre un partenariat tiers.

L’identité narrative est non négociable. Un avatar sans backstory cohérent, sans point de vue affiné, sans ligne éditoriale claire ne génère aucun attachement. L’audience ne s’abonne pas à un visuel. Elle s’abonne à un personnage.

La transparence est un choix stratégique, pas une contrainte. Signaler clairement qu’il s’agit d’un avatar IA n’est pas un aveu de faiblesse. C’est une position de marque. Selon Reuters (2023), 73 % des consommateurs de la genération Z déclarent ne pas être dérangés par les influenceurs virtuels du moment qu’ils savent à quoi ils s’abonnent.

La qualité de production est visible immédiatement. Un avatar rendu approximatif, une animation peu fluide, une voix synthétique non travaillée tout cela est perçu en quelques secondes. La qualité perçue de l’avatar est directement transférée sur la marque.

Le point de vue Infuse-IA

Chez Infuse-IA, nous considérons que la création d’un influenceur virtuel est avant tout un exercice de direction créative, pas un exercice technique.

La technologie qui permet de générer un avatar photoconvainquant est aujourd’hui accessible. Ce qui reste rare et déterminant c’est la capacité à construire un personnage qui tient dans le temps : une identité narrative forte, une cohérence visuelle sur tous les formats, une ligne éditoriale qui correspond exactement aux valeurs de la marque.

C’est ce que notre approche hybride produit : une direction créative humaine qui définit le personnage, l’univers et la stratégie de contenu et une intelligence de production qui assure la qualité, la cadence et l’adaptabilité des livrables.

Un influenceur virtuel de marque n’est pas un produit IA. C’est un actif stratégique. Il se conçoit, se constrüit et se pilote avec la même exigence qu’un lancement de produit.

FAQ Influenceurs virtuels et marketing IA

Qu’est-ce qu’un influenceur virtuel créé par IA ?

Un influenceur virtuel est un personnage numérique généré par intelligence artificielle, doté d’une identité visuelle, narrative et éditoriale construite, qui produit du contenu sur les réseaux sociaux et collabore avec des marques. Il n’existe pas physiquement mais interagit avec une communauté réelle. Son caractère, ses valeurs et ses prises de position sont intégralement définis par ses créateurs.

Les audiences acceptent-elles vraiment de suivre un influenceur artificiel ?

Oui, à condition que l’identité du personnage soit cohérente et la transparence assumée. Selon HypeAuditor (2024), les influenceurs virtuels génèrent en moyenne trois fois plus d’engagement que leurs équivalents humains à taille de communauté comparable. La génération Z, principale consommatrice de ce type de contenu, accepte très bien la nature artificielle du personnage du moment que celui-ci apporte une valeur narrative réelle.

Combien coûte la création d’un influenceur virtuel de marque ?

Le coût dépend du niveau de réalisme, de la fréquence de publication et de la complexité de l’identité construite. Il est généralement inférieur à celui d’un partenariat long terme avec une célébrité, dès lors que la phase de conception initiale est rigoureuse et que les assets sont mutualisés. La vraie variable économique, c’est la qualité de la direction créative en amont pas le coût de génération des visuels.

Quels secteurs bénéficient le plus des influenceurs virtuels ?

La mode, le luxe, la beauté et le retail sont les secteurs pionniers et les plus actifs. Mais la logique s’étend à tout secteur où l’image de marque est un actif central : tech grand public, alimentation premium, sport, divertissement. Le critère déterminant n’est pas le secteur c’est la capacité de la marque à construire une identité narrative pour son avatar.

L’influenceur virtuel remplace-t-il l’influenceur humain ?

Non. Les deux répondent à des logiques différentes. L’influenceur humain apporte de l’authenticité perçue, du vécu réel et une relation communautaire organique difficile à reproduire. L’influenceur virtuel apporte du contrôle, de la cohérence et de l’échelle. Les stratégies les plus performantes combinent les deux niveaux créateurs

humains pour l’ancrage relationnel, avatar de marque pour la visibilité permanente et maîtrisée.

Bandes-son IA et identité sonore de marque : ce que Suno, AIVA et Mubert changent réellement

Musique IA

La signature sonore de marque désigne l’ensemble des éléments musicaux et audio qui construisent la reconnaissance et l’image d’une marque dans ses contenus : jingle, ambiance musicale récurrente, habillage sonore des campagnes. Jusqu’ à récemment, en concevoir une supposait un budget de production musical significatif, des compositeurs spécialisés et des délais incompatibles avec les cycles de contenu actuels.

Les outils de composition IA changent cette équation. Ils ne remplacent pas le compositeur. Ils rendent la signature sonore accessible à des marques qui n’avaient pas les moyens de s’en doter et ils accélèrent radicalement le cycle de production pour celles qui en avaient déjà une.

Pourquoi l’identité sonore est un actif sous-estimé

La plupart des marques investissent massivement dans leur identité visuelle logo, charte couleur, typographie. Rares sont celles qui accordent le même niveau d’attention à leur identité sonore. C’est une erreur stratégique mesurable.

Selon Nielsen (2023), la mémorisation d’un message publicitaire augmente de 96 % lorsqu’il est associé à une musique cohérente avec l’image de marque, contre 38 % avec une musique neutre ou générique. L’audio n’est pas un habillage c’est un vecteur de mémorisation à part entière.

Spotify for Brands (2024) rapporte que 75 % des auditeurs associent spontanément une marque à son univers musical après trois expositions. Ce chiffre monte à 89 % quand la cohérence sonore est maintenue sur l’ensemble des formats (vidéo, podcast, réels, publicidé).

Le problème : maintenir cette cohérence sur des dizaines de contenus par mois, dans des formats et des durées variables, était jusqu’ici hors de portée pour la plupart des structures en croissance. C’est précisément ce que règlent les outils de composition IA.

Ce que les outils de composition IA permettent concrètement

Les plateformes de génération musicale par IA ne fonctionnent pas toutes de la même manière, ni ne servent les mêmes usages. La lecture correcte du marché suppose de distinguer quatre catégories d’usage.

Génération texte-vers-musique Suno, Udio

Suno et Udio permettent de générer des compositions complètes y compris avec voix chantées et paroles à partir d’un prompt textuel. Style, tempo, instrumentation, durée, structure : tout se pilote par la description. Suno produit des rendus

« radio-ready » avec une cohérence paroles/émotion remarquable pour des itérations rapides. Udio est plus musical, avec une richesse mélodique plus fine mais une courbe de prise en main légèrement plus longue.

Usage type : jingles produits, hymnes de marque, déclinaisons multilingues, formats 15/30/60s pour campagnes. Point de vigilance : vérifier les conditions de licence selon l’offre (version Pro recommandée pour usage commercial).

Composition orchestrale et cinématique AIVA

AIVA est spécialisée dans les compositions orchestrales, ambiantes et cinématiques. Elle est particulièrement adaptée aux films de marque premium, aux trailers et aux formats long format nécessitant une progression émotionnelle construite. La plateforme permet un niveau de paramétrage plus fin que les générateurs textuels structure harmonique, gammes, instruments. Les droits commerciaux sont intégrés dès les offres Standard.

Musique adaptée et habillage continu Mubert, Soundraw

Mubert génère des musiques libres de droits pilotées par prompts, avec une API permettant l’intégration directe dans les outils de production. Adapté aux habillages continus, aux fonds sonores de social media et aux formats adaptatifs qui varient en durée. Soundraw (intégré à Canva) cible plutôt les usages rapides posts, kits sociaux avec une prise en main minimale.

Synchronisation audio-vidéo ElevenLabs Video-to-Music, Aimi Sync

Ces outils résolvent un problème précis : la synchronisation automatique d’une bande-son sur un montage vidéo déjà réalisé. ElevenLabs analyse les émotions et le rythme du cut pour générer une musique calée sur le montage. Aimi Sync intègre le ducking automatique (baisse du volume musical pendant les voix) et le chapitrage sonore. Usage principal : habillage du cut final sans repasser par un compositeur.

Comment intégrer la composition IA dans un workflow de production

L’erreur la plus commune : traiter la musique comme un post-traitement. Elle arrive en dernier, choisie en 10 minutes dans une bibliothèque, déconnectée de la direction créative du contenu.

Un workflow optimisé intègre la signature sonore en amont, au même titre que la direction artistique visuelle. Voici la séquence qui produit les meilleurs résultats.

Étape 1 Définir le brief sonore. Mood, émotion cible, tempo, instrumentation, évitement (ce que la marque ne doit pas sonner). Ce brief est aussi précis que le brief visuel.

Étape 2 Générer plusieurs variations. Avec Suno ou Udio, produire 4 à 6 variations à partir du même brief textuel. Conserver les éléments différenciants entre chaque version pour avoir une palette.

Étape 3 Sélectionner et affiner. Sélectionner la variation la plus cohérente avec la direction créative. Ajuster tempo, structure ou tonale si l’outil le permet. Pas de perfectionnisme à ce stade l’itération est rapide.

Étape 4 Synchroniser sur le cut vidéo. Avec ElevenLabs Video-to-Music ou Aimi Sync pour l’alignement final, le ducking et les transitions.

Étape 5 Vérifier les droits avant diffusion. Confirmer que l’offre souscrite couvre l’usage commercial prévu (réseaux sociaux, broadcast, YouTube). Conserver les licences associées à chaque fichier.

Ce que la composition IA ne règle pas

Les outils de composition IA génèrent de la matière musicale. Ils ne construisent pas une identité sonore.

La différence est fondamentale. Une identité sonore, c’est un système : une logique de codes musicaux reconnaissables, déclinés de manière cohérente sur tous les points de contact, dans tous les formats, sur toute la durée de la marque. Ça ne s’improvise pas avec un prompt.

Selon MRC Data (2023), 68 % des consommateurs déclarent qu’une musique incohérente avec l’image de marque dégrade leur perception du contenu, même si celui-ci est visuellement réussi. Un bon rendu génératif mal intégré peut donc activement nuire.

Trois conditions déterminent si la composition IA produit un résultat utile ou un résultat neutre : la qualité du brief sonore en amont, la cohérence de la sélection avec la direction créative globale, et la rigueur de la synchronisation avec le contenu vidéo. Ce sont trois questions de jugement pas de génération.

Le point de vue Infuse-IA

Chez Infuse-IA, nous intégrons la composition IA dans nos workflows de production vidéo au même titre que la génération visuelle : comme un accélérateur, pas comme un substitut à la direction créative.

Ce qui change avec ces outils, c’est l’équation budgétaire. Une marque de taille intermédiaire peut aujourd’hui avoir une signature sonore cohérente sur l’ensemble de ses contenus réseaux sociaux, films de marque, formats publicitaires sans budget de production musicale traditionnel.

Ce qui ne change pas : la nécessité d’un brief sonore précis, d’une direction créative qui sait ce qu’elle veut faire entendre, et d’une production hybride capable d’intégrer ces éléments avec cohérence dans le livrable final.

La composition IA dit comment produire. La direction créative dit quoi produire et pourquoi.

FAQ Composition IA et identité sonore de marque

Qu’est-ce qu’une signature sonore de marque ?

La signature sonore de marque est l’ensemble des éléments musicaux et audio qui identifient une marque dans ses contenus : jingle, thème musical récurrent, ambiance sonore caractéristique. Elle fonctionne comme le logo visuel un signal de reconnaissance immédiat. Bien construite, elle améliore la mémorisation du message et renforce la cohérence de l’identité de marque sur tous les formats.

Peut-on utiliser commercialement la musique générée par Suno ou AIVA ?

Oui, à condition de souscrire une offre commerciale adaptée. Suno propose des licences commerciales dès son offre Pro. AIVA intègre les droits commerciaux dans ses offres Standard et au-delà. Mubert est conçu pour un usage commercial natif. Il est impératif de vérifier les conditions spécifiques à chaque plateforme et de conserver les justificatifs de licence pour chaque production.

Quelle différence entre Suno, AIVA et Mubert ?

Suno est optimisé pour la génération rapide de chansons complètes avec voix, idéale pour jingles et hymnes de marque. AIVA se spécialise dans les compositions instrumentales cinématiques et orchestrales, adaptées aux films de marque premium. Mubert génère des musiques adaptatives en temps réel à partir de prompts, conçues pour des habillages continus et des usages digitaux haute fréquence.

Comment briefer un outil de composition IA pour un résultat utilisable ?

Un brief sonore efficace spécifie : l’émotion cible (tension, énergie, sérénité, etc.), le tempo en BPM ou en description (lent, mid-tempo, rapide), les instruments préférés et ceux à éviter, la durée du format, et une référence sonore si possible. Plus le brief est précis, plus les variations générées sont utilisables sans itération supplémentaire.

Est-ce que la composition IA peut remplacer un compositeur professionnel ?

Sur des formats courts, standards et à haute cadence, les outils IA produisent des résultats commercialement exploitables sans compositeur dédié. Sur des projets à fort enjeu émotionnel film de marque premium, campagne institutionnelle, identité sonore fondatrice la direction créative humaine reste déterminante pour la pertinence du résultat. Les deux logiques sont complémentaires, pas substitutives.

Décors virtuels générés par IA : ce que les marques peuvent produire aujourd’hui sans studio physique

Décors virtuels IA

Un décor virtuel généré par IA est un environnement visuel de

synthèse intérieur, extérieur, paysage, espace fantastique ou réaliste produit à partir d’un prompt textuel ou d’une direction artistique, sans recours à un décor physique, à un plateau de tournage ou à un déplacement. Combinié à un avatar IA ou à un tournage green screen, il permet de produire des contenus vidéo dont le niveau de maîtrise visuelle était, il y a cinq ans encore, hors de portée pour toute structure en dehors des studios hollywoodiens.

Ce verrou vient de sauter. Et les marques qui le comprennent en avance ont un avantage de production structurel sur leurs concurrents.

Ce que la production virtuelle hollywoodienne a démontré et ce que ça change pour les marques

La référence de départ est connue : Disney a produit The Mandalorian sur un plateau équipé d’écrans LED géants (la technologie StageCraft d’ILM) diffusant en temps réel des environnements 3D rendus sous Unreal Engine. Les acteurs jouaient devant des décors virtuels photo-réalistes. Aucun tournage en extérieur. Aucun déplacement.

Ce que cette référence démontre n’est pas réservé au cinéma à gros budget. Elle valide un principe généralisable : un contenu ambitieux ne nécessite plus un décor physique. Il nécessite une direction artistique rigoureuse et des outils de génération capables de la matérialiser.

La démocratisation est réelle et rapide. Selon PwC (2024), le marché mondial de la production virtuelle qui englobe volumes LED, génération de décors par IA et post-production générative croît de plus de 30 % par an, porté en grande partie par l’adoption hors du secteur cinéma : publicité, contenu de marque, événementiel et formation.

Les outils qui permettaient ces rendus en 2020 coûtaient des millions d’euros d’infrastructure. En 2025, certains sont accessibles à moins de 100€ par mois.

Les trois technologies qui rendent cela concrètement accessible

1. La génération de décors par IA visuelle

Des outils comme Cuebric (basé sur Stable Diffusion), MidJourney ou Flux permettent de générer des environnements statiques ou animatables en haute résolution (4K, 8K) à partir d’un prompt textuel ou d’une référence visuelle. Un directeur artistique peut itérer sur des dizaines de variantes en quelques heures, affiner l’éclairage, la palette chromatique et l’atmosphère, avant d’arriver au décor retenu.

Cuebric est particulièrement adapté aux usages broadcast et contenu de marque : il génère des plans utilisables directement en fond vidéo ou sur écran LED, avec une cohérence de perspective et d’éclairage adaptée au tournage.

2. La production virtuelle sur écran LED (LED Volume)

Un volume LED est un plateau de tournage équipé d’écrans haute définition courbants diffusant en temps réel l’environnement virtuel généré. L’acteur joue devant le décor, qui réagit en temps réel aux mouvements de caméra. Le résultat est capturé in-camera sans incrustation post-production.

Des studios équipés de volumes LED existent désormais en France, accessibles à la location. Pour des formats courts et des contenus de marque à haute valeur perçue, c’est une solution qualitativement sans équivalent au même niveau de budget.

3. Le neural rendering et la génération 3D temps réel

Unreal Engine 5, couplé aux avancées du neural rendering, permet de générer et de modifier des scènes 3D photo-réalistes en quasi-temps réel. Des frameworks comme Scenethesis construisent des scènes tridimensionnelles à partir de descriptions textuelles, en assurant la cohérence géométrique et physique de l’environnement.

Autre avancée concrète : des outils comme « Anything in Any Scene » permettent d’insérer des objets photo-réalistes dans des vidéos existantes en maintenant la cohérence d’éclairage et de perspective ce qui ouvre des possibilités de post-production hybride très significatives pour les marques.

Ce que les marques peuvent produire concrètement grâce à ces outils

Selon Storyblocks (2024), 67 % des équipes de production vidéo déclarent que l’accès à des décors virtuels convaincants est le principal frein à la production de contenus plus ambitieux. Ce n’est pas un problème de compétence créative. C’est un problème de faisabilité budgétaire et logistique.

Les décors virtuels IA règlent précisément ce problème. Voici les formats que cela rend accessibles pour une marque de taille intermédiaire.

Spots publicitaires touristic ou émotionnels. Un paysage japonais, une villa méditerranéenne, un loft new-yorkais sans billet d’avion, sans location de décor, sans contrainte météorologique.

Présentations produit en environnement de marque. Montrer un produit dans le contexte d’usage idéal une cuisine premium, un bureau haut de gamme, un espace outdoor sans construire ce décor physiquement.

Contenus avatar de marque en décor immersif. Combiner un avatar IA et un décor virtuel cohérent pour des séries de contenus à haute valeur perçue, reproductibles et déclinables à grande échelle.

Films de marque à ambition cinématique. Des univers visuels inatteignables avec un budget de production traditionnel deviennent faisables dès lors que le décor est généré, pas construit.

Ce que ces technologies ne font pas à votre place

La génération de décors par IA produit de la matière visuelle. Elle ne produit pas une direction artistique.

Un décor virtuellement généré sans brief précis palette, atmosphère, cohérence avec l’univers de marque, adhérence au casting ou à l’avatar produit un fond visuellement plausible mais éditoriale-ment neutre. Il ressemble à n’importe quoi et à rien en particulier.

Trois conditions déterminent la qualité du résultat : la précision du brief visuel en amont, la cohérence entre le décor généré et l’identité de la marque, et la maîtrise technique de l’intégration dans le montage final éclairage, ombres, mouvement de caméra. Ce sont trois problèmes de production, pas de génération.

Le point de vue Infuse-IA

Chez Infuse-IA, les décors virtuels font partie de notre chaîne de production hybride au même titre que les avatars : ils permettent de produire des contenus dont le niveau d’ambition visuelle était jusqu’ici incompatible avec les budgets de nos clients.

Ce qui a changé ces deux dernières années, ce n’est pas la technologie les moteurs 3D temps réel existent depuis plus longtemps. Ce qui a changé, c’est la qualité de rendu accessible sans expertise technique spécialisée, et la vitesse d’itération qui permet d’explorer plusieurs directions artistiques dans un même cycle de production.

Un décor virtuel bien construit, c’est une image de marque plus forte, un contenu plus mémorable, et une liberté créative qui change la nature de ce qu’on peut promettre à un client.

La production hybride ne rend pas les productions moins ambitieuses. Elle rend les ambitions plus accessibles.

FAQ Décors virtuels IA et production de contenu

Qu’est-ce qu’un décor virtuel généré par IA ?

Chez Infuse-IA, les décors virtuels font partie de notre chaîne de production hybride au même titre que les avatars : ils permettent de produire des contenus dont le niveau d’ambition visuelle était jusqu’ici incompatible avec les budgets de nos clients.

Un décor virtuel généré par IA est un environnement visuel de synthèse produit par des algorithmes d’intelligence artificielle à partir d’un prompt textuel ou d’une direction artistique. Il peut représenter tout type d’espace intérieur, extérieur, réaliste ou fantastique et être utilisé comme fond vidéo, environnement de plateau LED ou élément de post-production.

Faut-il un plateau LED pour utiliser des décors virtuels ?

Non. Un décor virtuel peut être utilisé de plusieurs façons : comme fond incrusté en post-production (chroma key / green screen), comme arrière-plan animé sur écran LED sur un plateau de tournage, ou directement intégré dans un contenu full-CG. Le plateau LED offre le rendu in-camera le plus convaincant, mais n’est pas indispensable pour la majorité des usages marketing.

Quelle différence entre Cuebric, MidJourney et Unreal Engine pour les décors ?

Cuebric est spécialement conçu pour la production virtuelle : il génère des décors en haute résolution (jusqu’à 16K) adaptés aux écrans LED et aux fonds vidéo. MidJourney est plus polyvalent excellent pour l’itération créative et la recherche de direction artistique, mais moins optimisé pour les contraintes techniques de production. Unreal Engine permet la génération 3D temps réel avec une cohérence physique et d’éclairage maximale, mais suppose une expertise technique significative.

Combien coûte la production d’un contenu vidéo avec décor virtuel IA ?

Le coût dépend du format, du niveau de réalisme et de la solution technique retenue. Un contenu court utilisant un décor généré par IA en fond green screen est significativement moins coûteux qu’un tournage en décor physique équivalent. Un tournage sur volume LED représente un investissement plus élevé mais offre un rendu in-camera sans équivalent. Dans les deux cas, l’économie par rapport à la construction d’un décor physique réel est structurellement favorable.

Les décors virtuels IA sont-ils détectables par le spectateur ?

De moins en moins. Les avancées du neural rendering et des moteurs 3D temps réel ont considérablement réduit l’écart de rendu avec la prise de vue réelle. La principale variable qui détermine si un décor virtuel est perçu comme tel n’est plus la qualité de rendu technique c’est la cohérence d’éclairage entre le sujet filmé et l’environnement généré. C’est une question de direction de production, pas de technologie.

Avatars IA en marketing vidéo : ce qu’ils changent vraiment pour la production et l’engagement de marque

Avatars IA

Un avatar IA en marketing vidéo est un personnage numérique animé par intelligence artificielle clone réaliste d’un porte-parole réel ou personnage synthétique construit de zéro capable de délivrer un discours vidéo dans n’importe quelle langue, sur n’importe quel format, sans recourir à un tournage. Il est généré à partir d’un script, d’un modèle visuel et d’une voix synthétique. Une fois construit, il peut être réemployé indéfiniment adapté, multilingue, décliné sur tous les canaux.

C’est la nature structurelle de ce changement qui importe. Pas la technologie en elle-même ce qu’elle rend possible dans les décisions de production, de fréquence et de cohérence de contenu.

Pourquoi la vidéo de marque devient le format central et pourquoi les avatars règlent le problème de volume

La vidéo n’est plus un format parmi d’autres. Selon le Wyzowl State of Video Marketing (2024), 91 % des entreprises utilisent la vidéo comme outil marketing, et 87 % d’entre elles déclarent qu’elle génère un retour sur investissement positif. C’est le format qui convertit le mieux, qui est le plus partagé et qui construit le plus efficacement la confiance.

Le problème : produire de la vidéo de qualité à fréquence suffisante reste coûteux et lent. Un tournage mobilise du temps, un lieu, un réalisateur, un ou plusieurs

talents et tout recommence à zéro pour le prochain format.

Les avatars IA cassent cette équation. Synthesia (2024) rapporte que ses clients produisent leurs vidéos avec des avatars IA à un coût moyen 60 % inférieur à la production vidéo traditionnelle équivalente, avec des délais réduits de 80 %. Ce n’est pas une estimation c’est une donnée issue de l’usage réel de plus de 50 000 entreprises clientes de la plateforme.

Ce que cela change concrètement : une marque peut passer d’une vidéo par trimestre à une vidéo par semaine. Sans recruter, sans tourner, sans dépasser son budget.

Les trois types d’avatars IA : lesquels correspondent à quel usage

Tous les avatars IA ne fonctionnent pas de la même façon, ni ne servent les mêmes objectifs. Distinguer les trois catégories principales évite les mauvais choix de solution.

Le clone numérique d’un porte-parole réel

Un clone numérique est généré à partir d’une session de tournage courte (30 à 60 minutes) d’un dirigeant, d’un expert ou d’un commercial. Le modèle IA apprend les traits visuels, les micro-expressions et la voix de la personne. Il peut ensuite délivrer n’importe quel script dans la langue de son choix, sans nouveau tournage.

Usage type : CEO qui s’exprime dans 12 pays sans voyager, commercial qui envoie des vidéos personnalisées à chaque prospect, expert métier présent sur tous les formats de contenu simultanément. Le réalisme du rendu est maximal c’est la personne réelle qui parle, avec sa gestuelle et son timbre de voix.

L’avatar synthétique générique

Un avatar synthétique est un personnage numérique construit entièrement par

IA sans modèle humain réel. Des plateformes comme Synthesia, HeyGen ou D-ID proposent des bibliothèques de personnages pré-construits, utilisables immédiatement et disponibles dans de nombreuses langues.

Usage type : vidéos de formation, tutoriels produit, onboarding client, contenus explicatifs à haute fréquence. Solution la plus rapide à déployer, mais qui offre moins de différenciation visuelle qu’un clone ou qu’un avatar de marque construit sur mesure.

L’avatar de marque construit sur mesure

C’est l’approche la plus ambitieuse et la plus différenciante. Un avatar de marque est un personnage original visuellement distinct, narrativement construit, cohérent avec l’identité de la marque conçu spécifiquement pour une campagne, une gamme ou une image long terme.

Il peut être réaliste ou stylisé, humanoïde ou non, basé sur un modèle réel ou entièrement de synthèse. Ce qui le définit, c’est sa cohérence narrative et son ancrage dans la stratégie de contenu de la marque. C’est le territoire où l’avatar cesse d’être un outil de production et devient un actif de marque.

Ce que la personnalisation vidéo par avatar change pour l’engagement

La personnalisation est le levier d’engagement le plus puissant de la vidéo. Selon HubSpot (2024), les vidéos personnalisées celles qui s’adressent nominalement au destinataire ou adaptent leur contenu à son profil génèrent en moyenne 2 fois plus d’engagement que les vidéos génériques diffusées à grande échelle.

Jusqu’ici, la personnalisation vidéo à grande échelle était une contrainte logistique impossible tourner une version par segment, par région ou par persona n’était pas réaliste. Les avatars IA le rendent opérationnel.

Un même avatar peut délivrer 500 scripts différents chacun adapté au nom, au secteur, au cas d’usage du destinataire sans un seul tournage supplémentaire.

Les déclinaisons multilingues sont générées automatiquement même voix, même visage, même registre dans 30 langues ou plus selon les plateformes.

Les formats courts peuvent être produits à très haute cadence stories, réels, shorts sans renoncer à la cohérence visuelle et narrative.

Ce qui distingue un avatar IA qui fonctionne d’un avatar qui nuit

Un avatar mal construit est pire qu’une absence d’avatar. La vallée de l’étrange le sentiment d’inconfort face à un personnage presque humain mais pas tout à

fait active une réponse de méfiance immédiate chez le spectateur. Elle se transfère sur la marque.Quatre variables déterminent la qualité perçue d’un avatar.

La fléxité labiale et la synchronisation phonétique. C’est le premier signal de qualité. Un léger décalage entre l’audio et le mouvement des lèvres dégrade immédiatement la crédibilité.

La cohérence visuelle entre l’avatar et l’univers de marque. Apparence, tenue, décor, éclairage tout doit s’inscrire dans la direction artistique de la marque. Un avatar techniquement réussi dans un environnement visuellement générique ne produit aucun effet de marque.

La qualité du script et du débit. Un script plat ou un débit monotone signale immédiatement l’artificiel. La direction éditoriale et le rythme d’élocution sont aussi importants que le rendu visuel.

La transparence sur la nature de l’avatar. Signaler qu’il s’agit d’un personnage généré par IA n’affaiblit pas la crédibilité au contraire. L’audience accepte la technologie quand elle est assumée. Elle rejette la tromperie.

Les plateformes qui permettent de produire des avatars IA aujourd’hui

Le marché s’est structuré rapidement. Quelques acteurs se dégagent par niveau de maturité et de cas d’usage.

Synthesia Référence du marché pour les avatars synthétiques et les clones. Large bibliothèque de personnages, multilinguisme natif, interface accessible sans compétence technique. Idéale pour les usages à haute fréquence : formation, onboarding, communication interne.

HeyGen Très performante sur les clones numériques et la synchronisation labiale. La qualité de rendu des clones est parmi les meilleures du marché pour les usages marketing et commerciaux.

D-ID Spécialisée dans l’animation d’images statiques et la création d’avatars interactifs. Pertinente pour les usages conversationnels et les agents virtuels.

• Runway / Kling / Sora Pour la génération vidéo image-to-video ou text-to-video, utilisés en complément pour les décors, les transitions et les séquences visuelles autour de l’avatar.

Le point de vue Infuse-IA

Chez Infuse-IA, les avatars sont notre porte d’entrée pas notre plafond.

Un avatar bien construit est le démonstrateur le plus visible de ce que la production hybride permet : un contenu à haute valeur perçue, produit rapidement, cohérent sur tous les formats, sans les contraintes logistiques d’un tournage classique.

Mais ce qui fait la différence entre un avatar utilisé une fois et un avatar qui devient un actif durable, c’est la qualité de la direction créative amont : identité visuelle du personnage, ligne éditoriale, cohérence avec la stratégie de contenu globale. La technologie exécute. La direction créative décide.

C’est précisément cette combinaison intelligence de production et exigence créative qui transforme un rendu génératif en contenu de marque.

FAQ Avatars IA et marketing vidéo

Qu’est-ce qu’un avatar IA en marketing vidéo ?

Un avatar IA en marketing vidéo est un personnage numérique animé par intelligence artificielle, capable de délivrer un discours vidéo à partir d’un script texte. Il peut être la réplique numérique d’une personne réelle (clone) ou un personnage synthétique construit de zéro. Une fois créé, il peut produire un volume illimité de contenus multilingues, adaptés, déclinés sans nouveau tournage.

Quelle différence entre un clone numérique et un avatar synthétique ?

Un clone numérique est généré à partir d’une session de tournage d’une personne réelle il reproduit ses traits, sa voix et ses expressions. Un avatar synthétique est un personnage entièrement artificiel, sans modèle humain réel. Le clone offre le réalisme maximal et la proximité avec le porte-parole de la marque. L’avatar synthétique est plus rapide à déployer mais moins différenciant.

Combien de temps faut-il pour produire un avatar IA de marque ?

Un avatar synthétique générique est opérationnel en quelques heures. Un clone numérique nécessite une session de tournage de 30 à 60 minutes et un temps de formation du modèle de 24 à 72 heures selon la plateforme. Un avatar de marque construit sur mesure avec direction artistique, identité visuelle et décor demande plusieurs jours de production mais livre un actif réutilisable indéfiniment.

Les avatars IA sont-ils adaptés à tous les secteurs ?

Ils sont particulièrement efficaces dans les secteurs où le volume de contenu vidéo est élevé et où la personnalisation est un levier clé : formation, communication interne, vente B2B, e-commerce, finance, immobilier, santé. Ils sont moins adaptés

aux formats qui nécessitent une authenticité d’expérience vécue témoignages clients, reportages, contenus de lifestyle ancrés dans le réel.

Faut-il informer son audience qu’elle regarde un avatar IA ?

C’est à la fois une obligation éthique et un choix stratégique avisé. Les réglementations sur la transparence des contenus générés par IA se renforcent en Europe et aux États-Unis. Au-delà du cadre légal, signaler la nature IA de l’avatar renforce la confiance les audiences acceptent la technologie quand elle est assumée. La tromperie, même involontaire, génère un risque réputationnel significatif.

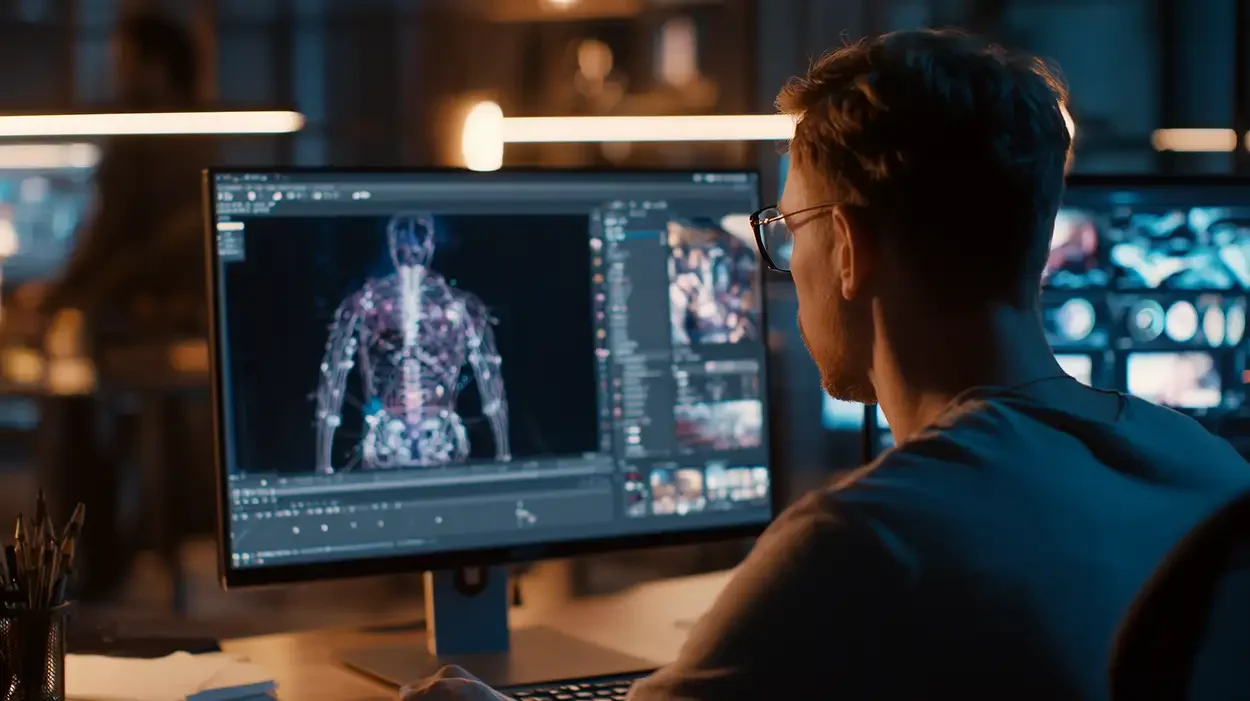

Tracking de mouvement par IA : la technologie qui rend les avatars convaincants et la post-production accessible

Tracking de mouvement par IA

Le tracking de mouvement par IA désigne l’ensemble des technologies qui permettent d’analyser, capturer et reproduire des mouvements corps, visage, caméra à partir d’une simple vidéo, sans combinaison de capteurs spécialisés ni infrastructure de studio dédiée. En production de contenu, c’est la brique technique qui fait la différence entre un avatar statique et un avatar convaincant et entre une intégration VFX qui tient à l’écran et une qui ne tient pas.

Ce qui était réservé aux studios dotés d’équipements à six chiffres il y a cinq ans est aujourd’hui accessible depuis un navigateur web. Ce déplacement est structurel.

Un marché en croissance rapide, porté par la démocratisation des usages

Le marché mondial de la capture de mouvement est estimé à 2,9 milliards de dollars en 2024 et devrait dépasser 5 milliards d’ici 2029, soit une croissance annuelle de 11,5 % (Grand View Research, 2024). La dynamique n’est plus tirée par les seuls studios cinéma et jeux vidéo les secteurs de la formation, du marketing, de la communication d’entreprise et de l’e-commerce contribuent de plus en plus à cette croissance.

Le facteur accélérateur : le tracking sans marqueur. Les solutions basées sur l’IA n’exigent plus de combinaison de capteurs ni de salle calibrée. Une caméra standard, une vidéo existante ou un simple smartphone suffisent désormais à produire des animations de qualité professionnelle.

L’exemple le plus cité hors du cinéma traditionnel : Netflix a utilisé des VFX générés par IA dans la série arg entine The Eternaut pour une séquence complexe de destruction, produite 10 fois plus vite qu’avec les méthodes traditionnelles (TechRadar, 2024). Ce chiffre n’est pas anecdotique il indique l’ordre de grandeur des gains de production que ces technologies rendent possibles.

Les trois catégories du tracking IA : corps, visage, caméra

Distinguer ces trois catégories est essentiel pour choisir le bon outil et comprendre ce qu’elles apportent respectivement dans un workflow de production de contenu.

Le tracking corporel sans marqueur (markerless body tracking)

Le tracking corporel analyse les vidéos d’une personne en mouvement et en extrait un squelette animé en 3D sans combinaison de capteurs, sans calibration, à partir d’une vidéo enregistrée avec n’importe quelle caméra. Le squelette généré peut ensuite être appliqué à un avatar 3D, un personnage animé ou un personnage de jeu.

Cas d’usage concrets pour les marques : animer un avatar de marque avec les gestes naturels d’un porte-parole réel, produire des démonstrations produit avec un personnage en mouvement fluide, générer des séquences d’animation sans budget de motion capture traditionnel.

Le tracking facial (face tracking et expression capture)

Le tracking facial capture les micro-expressions, les mouvements labiaux et les émotions d’un visage réel pour les transposer sur un avatar ou un personnage numérique. C’est la clé de la synchronisation labiale convaincante et du réalisme émotionnel des avatars.

C’est la variable technique qui sépare un clone IA fluide d’un clone IA mécanique. La qualité du face tracking détermine directement la qualité perçue de l’avatar et donc la confiance que lui accorde le spectateur.

Le tracking de caméra (camera tracking et match-moving)

Le tracking de caméra analyse les mouvements d’une caméra dans une vidéo réelle pour récréer sa trajectoire en 3D. Il permet d’insérer des éléments

numériques personnages, objets, textes, décors dans une prise de vue réelle en maintenant une cohérence parfaite de perspective et de mouvement.

Usage type en contenu de marque : intégrer un avatar ou un produit numérique dans une vidéo tournée en conditions réelles, ajouter des éléments graphiques qui suivent le mouvement de caméra, ou composer un plan hybride sans reconstruire l’environnement en studio.

Les outils accessibles en 2026 : du prototype au workflow professionnel

Le marché des outils de tracking IA s’est structuré en deux niveaux : des solutions accessibles sans expertise technique poussée, et des plateformes professionnelles pour les workflows de production exigeants.

Solutions accessibles sans infrastructure lourde

DeepMotion Génère des animations 3D à partir d’une vidéo standard. Accessible depuis un navigateur, sans installation. L’IA analyse les mouvements et produit un fichier d’animation compatible avec les principaux logiciels 3D (Maya, Blender, Unreal Engine). Idéal pour animer des avatars à partir de vidéos existantes.

Rokoko Vision Capture de mouvement gratuite utilisable depuis une webcam ou un smartphone. Selon Rokoko (2024), plus de 200 000 créateurs utilisent leurs outils pour produire des animations sans équipement spécialisé.

Pertinent pour les petites structures qui veulent intégrer du tracking dans leur workflow sans investissement matériel.

• Wonder Dynamics / Autodesk Flow Studio Analyse un plan vidéo standard pour générer automatiquement le tracking corporel, le match-moving caméra et l’intégration d’un personnage 3D. Exportable dans Maya ou Unreal Engine. Gain de temps majeur sur les workflows d’intégration CG.

Solutions de niveau professionnel

Runway Aleph Manipulation d’un plan vidéo existant via du texte : changement d’angle de caméra, suppression d’objets, relighting, modification de scène. Le tracking s’opère en arrière-plan pour maintenir la cohérence temporelle. Outil puissant mais qui nécessite un jugement artistique pour éviter les dérives de rendu.

Boris FX / Mocha Pro Référence professionnelle pour le tracking plan, la rotoscopie assistée par IA et la suppression d’objets. Intégré nativement dans After Effects, Nuke et DaVinci Resolve. Utilisé dans des productions broadcast et publicitaires exigeantes.

Faceware Technologies Spécialiste de la capture faciale en temps réel et en post-production. Transpose la performance faciale d’un acteur sur un personnage numérique avec une fidélité d’expression élevée. Adapté aux productions qui exigent un niveau de réalisme émotionnel maximal.

Ce que le tracking IA ne règle pas automatiquement

Les outils de tracking IA automatisent l’analyse et la capture. Ils n’automatisent pas les décisions de production.

Trois points de vigilance concrets dans un workflow de contenu de marque.

La qualité de la source détermine la qualité du tracking. Un plan sous-exposé, flou ou mal cadré produit un tracking dégradé. L’IA amplifie la qualité elle ne la compense pas. La rigueur de tournage reste non négociable.

L’œil humain est indispensable pour la correction des

artefacts. Glissements de tracking, distorsions sur les mouvements rapides, incohérences d’éclairage lors de l’intégration ces problèmes existent encore, même avec les meilleurs outils. La post-production manuelle reste nécessaire sur les plans à fort enjeu.La cohérence entre le tracking et la direction artistique globale. Un avatar dont les mouvements sont techniquement corrects mais éditoriale-ment plats ne crée aucun impact. La fluidité technique doit servir une intention une énergie, une posture, un registre. C’est une décision de mise en scène, pas un paramètre logiciel.

Le point de vue Infuse-IA

Chez Infuse-IA, le tracking de mouvement est la brique invisible qui conditionne la qualité visible des avatars.

Un avatar de marque qui bouge de façon fluide et naturelle, dont la synchronisation labiale est impécable et dont les expressions sont cohérentes avec le discours c’est le résultat d’une chaîne de tracking bien exécutée. Ce n’est pas visible dans le livrable final. Mais son absence l’est immédiatement.

Ce qui nous intéresse dans ces outils, ce n’est pas leur sophistication technique. C’est ce qu’ils permettent de produire pour des clients qui n’ont pas de budget de studio hollywoodien et qui ont pourtant des exigences de qualité perçue élevées.

La production hybride, c’est précisément ça : utiliser la puissance des outils IA là où ils accélèrent sans compromis, et maintenir une direction de production humaine là où le jugement fait la différence.

FAQ Tracking de mouvement par IA

Qu’est-ce que le tracking de mouvement par IA ?

Le tracking de mouvement par IA désigne les technologies qui analysent des vidéos pour capturer automatiquement les mouvements d’un corps, d’un visage ou d’une caméra, sans capteurs physiques. Le résultat est un fichier d’animation ou de tracking utilisable dans un logiciel 3D, un moteur en temps réel ou un outil de post-production. En production de contenu, il permet d’animer des avatars, d’intégrer des éléments numériques dans des vidéos réelles et d’accélérer les workflows VFX.

Faut-il un équipement spécial pour faire du tracking de mouvement par IA ?

Non, pour la grande majorité des usages en contenu de marque. Des outils comme DeepMotion ou Rokoko Vision fonctionnent à partir d’une vidéo tournée avec n’importe quelle caméra standard, voire un smartphone. Les solutions industrielles haute précision (combinaisons Xsens, systèmes Vicon) restent utiles pour les productions exigeant un rendu de mouvement extrement détaillé, mais ne sont pas nécessaires pour des avatars de marque ou des contenus corporate.

Quelle différence entre le tracking corporel et le tracking facial ?

Le tracking corporel capture les mouvements du corps posture, gestuelle, déplacements pour animer le squelette d’un personnage 3D. Le tracking facial capture les micro-expressions, les émotions et les mouvements labiaux pour transposer la performance d’un visage réel sur un avatar numérique. Les deux sont complémentaires : le tracking corporel anime le personnage, le tracking facial lui donne une expression convaincante.

Comment le tracking de caméra s’utilise-t-il dans la production de contenu de marque ?

Le tracking de caméra (ou match-moving) reconstruit la trajectoire d’une caméra à partir d’une vidéo réelle. Il permet d’insérer des éléments numériques avatar, produit 3D, décor, texte dans ce plan en respectant la perspective et le mouvement de

caméra original. En contenu de marque, c’est la technique qui permet de combiner du réel et du génératif de façon seamless.

Quels sont les limites actuelles du tracking IA sans marqueur ?

Les principales limites : les mouvements très rapides ou les occlusions (quand une partie du corps passe derrière une autre) génèrent encore des artefacts sur certains outils. Les plans mal éclairés, flous ou très compressés dégradent la qualité du tracking. Et la correction manuelle des glissements reste nécessaire sur les productions à fort enjeu. Ces limitations s’améliorent rapidement, mais la supervision humaine reste une étape de production non optionnelle.

VFX et IA : ce que les effets visuels génératifs changent pour la production de contenu de marque

VFX & IA

Les VFX génératifs désignent l’ensemble des techniques de post-production vidéo assistées par intelligence artificielle rotoscopie automatique, suppression d’éléments, remplacement de décors, déaging, génération de séquences visuelles complexes qui permettent d’obtenir des rendus jusqu’ici réservés aux productions à gros budget, dans des délais et à des coûts radicalement réduits.

La rupture n’est pas technologique. Elle est économique. Ce que Disney, Netflix et les grandes maisons de production ont validé en laboratoire depuis 2022 est aujourd’hui accessible à des structures bien plus petites. La question n’est plus

« est-ce possible ?» c’est « comment l’utiliser avec discernement ?»

Les chiffres qui mesurent l’écart entre avant et après

Avant de cartographier les usages, deux chiffres concrets permettent de mesurer ce que l’IA change dans les workflows VFX.

Premier chiffre : en débruitage de rendu 3D avec OpenImage Denoise sur Blender, un projet de 490 images est passé d’un temps de rendu total de 200 jours à 18 jours soit une réduction de 91 % du temps de calcul (Molten Cloud, 2024). Sur un projet de production publicitaire ou de contenu de marque, ce gain se traduit directement en coût et en délai.

Deuxième chiffre : le film Here (2024), produit pour 50 millions de dollars, a utilisé une IA de déaging développée par Metaphysic pour rajeunir Tom Hanks et Robin Wright sur 60 ans de narration, en temps réel sur le plateau (WIRED, 2024). Netflix déclare de son côté que l’IA lui permet d’offrir à des productions à budget limité des effets jusqu’ici réservés aux films à 200 millions avec une amélioration de qualité visuelle d’au moins 10 % (Business Insider, 2025).

Ces deux exemples ne sont pas des exploits de laboratoire. Ce sont des indicateurs de démocratisation réelle. Ils confirment que l’écart de faisabilité entre une production hollywoodienne et une production de marque ambitieuse se réduit structurellement.

Les quatre applications VFX les plus utiles pour la production de contenu de marque

Tous les usages VFX ne sont pas pertinents pour un studio de production de contenu. Voici les quatre applications qui offrent le meilleur rapport valeur/accessibilité pour les marques en 2025.

1. La rotoscopie et la suppression d’éléments

La rotoscopie découpage image par image d’un sujet de son fond était l’une des tâches les plus chronophages de la post-production. Des outils IA comme Adobe After Effects Roto Brush 3, Boris FX Silhouette ou DaVinci Resolve génèrent désormais des masques précis en quelques secondes, sur des séquences complexes avec déplacements et occlusions.

Applications directes : extraction d’un porte-parole de son décor pour insertion dans un environnement de marque, suppression d’éléments indésirables dans un plan tourné, création de composites hybrides réel/génératif.

2. Le remplacement et la génération de décors en post-production

Au-delà du green screen classique, les outils de génération vidéo IA permettent aujourd’hui de remplacer ou d’étendre un décor dans une vidéo existante en maintenant la cohérence d’éclairage et de perspective. Runway Aleph permet par exemple de changer l’arrière-plan d’un plan, de modifier l’éclairage ou de générer un nouvel angle de caméra à partir d’une vidéo source.

Ce que cela change : un contenu tourné dans un lieu ordinaire peut être repositionné dans un univers de marque fort, sans retourné.

3. La correction et le raffinement de l’image à grande échelle

Les outils de denoising (débruitage), d’upscaling (augmentation de résolution) et de stabilisation IA permettent de transformer des plans d’entrée techniquement imparfaits en livrables professionnels. Topaz Video AI, DaVinci Resolve Magic Mask, OpenImage Denoise ces outils automatisent des corrections qui demandaient auparavant des heures de travail manuel.

Application directe : recycler des archives vidéo de qualité moyenne pour en faire des contenus publiables, ou améliorer significativement la qualité perçue d’une production à budget contrôlé.

4. La génération de séquences visuelles complètes

Des outils comme Runway Gen-3, Kling ou Sora permettent de générer des séquences vidéo complètes à partir d’une image, d’un texte ou d’une vidéo source. Le niveau de contrôle varie selon les plateformes mouvement de caméra, durée, style visuel mais le potentiel pour les séquences de transition, d’ouverture ou d’illustration visuelle est déjà significatif.

Les outils qui composent un workflow VFX IA accessible

Un workflow VFX IA compétitif en 2026 s’articule autour de quelques plateformes complémentaires. Voici les plus pertinentes pour une structure de production de contenu.

DaVinci Resolve (Blackmagic) Suite de post-production qui intègre nativement des outils IA pour le masquage, la rotoscopie (Magic Mask), la colorimétrie assitée et la suppression d’objets (IntelliTrack). Gratuit dans sa version standard. Référence du marché pour la post-production professionnelle accessible.

Runway ML (Gen-3 Alpha) Génération vidéo, remplacement de décor, suppression d’éléments. Adopté par Disney et Netflix pour certaines productions. Runway Aleph apporte en plus la manipulation de plans réels par texte.

Topaz Video AI Spécialisé dans l’upscaling, la stabilisation et le denoising vidéo. Transforme des sources 720p en livrables 4K con vaincants. Utile pour les archives et les tournages en conditions limitées.

Boris FX / Mocha Pro Référence professionnelle pour le tracking plan avancé, la rotoscopie assistée et la suppression d’objets complexes. Intégré natif dans After Effects, Nuke et DaVinci Resolve.

Adobe After Effects + Firefly L’intégration progressive de Firefly dans After Effects amène la génération de textures, de fonds et d’éléments visuels directement dans le workflow de composition. Pertinent pour les studios qui travaillent déjà dans l’écosystème Adobe.

Ce que les VFX IA ne font pas sans direction de production

Les outils VFX IA automatisent des tâches techniques. Ils ne prennent pas de décisions créatives.

Un remplacement de décor techniquement réussi dans un univers visuellement incohérent avec la marque produit un résultat neutre, au mieux, et contre-productif au pire. La cohérence d’éclairage entre le sujet filmé et le décor généré, la pertinence du choix stylistique, la lisibilité du message dans le plan composite ce sont des décisions de mise en scène et de direction artistique, pas des paramètres logiciels.

Il y a aussi la question des artefacts. Même les meilleurs outils produisent des imperfections sur les mouvements rapides, les bords complexes ou les transitions difficiles. La revue manuelle par un œil formé reste non négociable sur les livrables à fort enjeu.

Le point de vue Infuse-IA

Ce que ces outils permettent concrètement : proposer à des marques de taille intermédiaire des niveaux de finition visuelle qui étaient jusqu’ici hors budget. Corriger un éclairage imparfait, composer un plan hybride réel/génératif, recycler des archives pour produire du contenu publiable tout cela devient opérationnel dans un workflow de production hebdomadaire.

Chez Infuse-IA, nous intégrons les VFX génératifs dans nos productions comme un accélérateur de qualité perçue pas comme un raccourci.

Ce qui ne change pas : l’exigence de la direction artistique en amont. Un VFX mal intégré dégrade l’image de marque plus sûrement qu’une image imparfaite mais authentique. La technologie amplifie les bonnes décisions comme les mauvaises.

La production hybride, c’est savoir utiliser ces outils là où ils servent le contenu pas les utiliser parce qu’ils existent.

FAQ VFX IA et production de contenu

Qu’est-ce que les VFX génératifs ?

Les VFX génératifs désignent les effets visuels produits ou assistés par des algorithmes d’intelligence artificielle rotoscopie automatique, suppression d’objets, remplacement de décors, génération de séquences, déaging. Ils se distinguent des VFX traditionnels par leur vitesse d’exécution et leur accessibilité : des tâches qui demandaient des heures ou des jours de travail spécialisé se réalisent en quelques minutes avec les bons outils.

Les VFX IA sont-ils réellement accessibles hors des gros studios ?

Oui, de plus en plus. Des outils comme DaVinci Resolve (gratuit), Runway ML, Topaz Video AI ou Boris FX sont utilisés par des studios indépendants et des équipes de contenu de marque. L’accès aux capacités qui nécessitaient des infrastructures à six chiffres en 2020 est aujourd’hui disponible via des abonnements mensuels ou des licences annuelles accessibles à des petites structures.

Quelle différence entre la rotoscopie IA et la rotoscopie traditionnelle ?

La rotoscopie traditionnelle consiste à découper manuellement le sujet de son fond, image par image. Sur une séquence de 30 secondes à 25 images par seconde, cela représente 750 images à traiter une par une. La rotoscopie assistée par IA génère automatiquement les masques sur l’ensemble de la séquence en quelques secondes, avec une précision suffisante pour la grande majorité des usages commerciaux. La correction manuelle reste nécessaire sur les bords complexes.

Peut-on améliorer la qualité d’un tournage existant avec les VFX IA ?