IA générative, droits d’auteur et transparence : ce que les marques doivent savoir et faire en 2026

Produire du contenu avec des outils d’IA générative soulève trois catégories de questions distinctes : les droits sur les données d’entraînement des modèles utilisés, la propriété des contenus générés, et les obligations de transparence vis-à-vis des audiences et des régulateurs. Ces trois questions ne sont pas encore toutes tranchées juridiquement. Mais le cadre se précise rapidement et les marques qui ne s’y préparent pas prennent un risque réputationnel et légal mesurable.

Cet article ne se substitue pas à un conseil juridique. Il donne les éléments d’information nécessaires pour poser les bonnes questions et prendre des décisions de production informées.

La question des droits d’auteur sur les données d’entraînement

Le premier enjeu juridique autour de l’IA générative concerne l’entraînement des modèles. La grande majorité des modèles d’image, de vidéo et de texte disponibles ont été entraînés sur des corpus de données dont une partie est protégée par le droit d’auteur.

Plusieurs procès majeurs ont été engagés sur ce sujet. Getty Images a poursuivi Stability AI au Royaume-Uni pour utilisation non autorisée de plusieurs millions d’images protégées. En juin 2025, Disney et Universal ont engagé une action contre Midjourney pour reproduction non autorisée de personnages protégés Dark Vador, les Minions et d’autres (AP News, 2025). Ces procès n’ont pas encore tous abouti à une jurisprudence stabilisée, mais ils dessinent le contour du cadre à venir.

Ce que cela signifie concrètement pour une marque : utiliser un outil génératif grand public ne garantit pas que les contenus produits sont exempts de toute question de droits. Le risque est faible pour les générations abstraites ou stylées. Il est réel dès qu’une sortie ressemble de près à une œuvre, un personnage ou un style identifiable protégé.

Qui détient les droits sur un contenu généré par IA ?

C’est la deuxième question, et l’une des plus pra tiquement importantes pour les marques qui produisent du contenu.

La position actuelle des offices de propriété intellectuelle

Le Copyright Office américain a confirmé en 2023 qu’une œuvre entièrement générée par IA sans contribution créative humaine significative ne peut pas bénéficier d’une protection par le droit d’auteur. En Europe, le cadre juridique est similaire : la création protectable suppose une « empreinte de la personnalité » de l’auteur humain.

En pratique : les contenus où l’humain apporte une contribution créative démontrable sélection, direction artistique, montage, modification significative sont plus susceptibles de bénéficier d’une protection. Les contenus entièrement générés sans intervention human sont dans une zone grise. Cette distinction est importante pour les marques qui souhaitent protéger leurs actifs créatifs.

Les conditions d’utilisation des plateformes

La question des droits ne dépend pas uniquement du droit d’auteur elle dépend aussi des conditions générales d’utilisation de chaque plateforme. Midjourney, Suno, HeyGen, Synthesia ou Runway ont chacun des politiques différentes sur la propriété des sorties et les usages commerciaux autorisés.

Trois vérifications à faire systématiquement avant d’utiliser commercialement un contenu génératif : l’usage commercial est-il explicitement autorisé dans l’offre souscrite ? La plateforme conserve-t-elle des droits sur les sorties ? Les contenus peuvent-ils être utilisés dans des publicidés diffusées en broadcast ?

Le cadre réglementaire qui s’applique et ce qui arrive

L’AI Act européen : les obligations de transparence

L’AI Act, entré en vigueur en 2024, est le cadre réglementaire le plus complet à ce jour sur l’IA en Europe. Il impose plusieurs obligations directement pertinentes pour les producteurs de contenu.

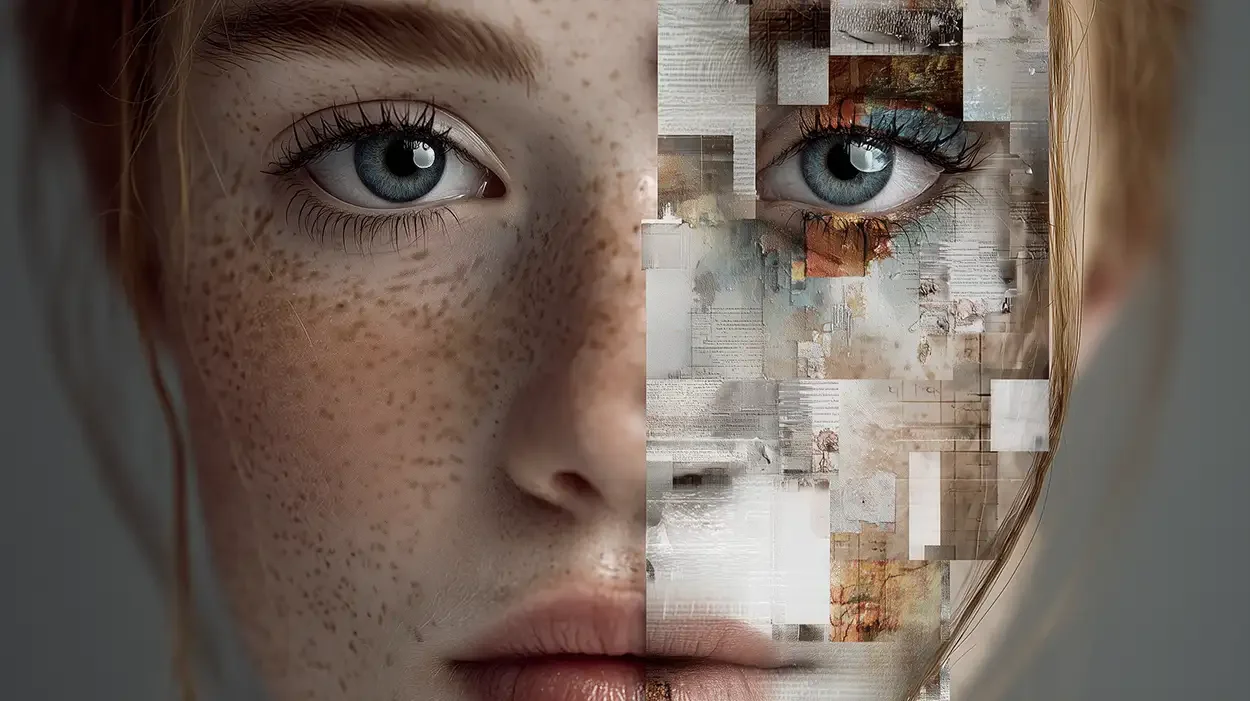

Marquage des contenus synthétiques. Les deepfakes et contenus générés par IA doivent être signalés comme tels lorsqu’ils représentent des personnes réelles dans des situations fictives ou lorsqu’ils peuvent tromper le public.

Transparence sur les données d’entraînement. Les fournisseurs de modèles d’IA à usage général doivent publier un résumé des données utilisées pour l’entraînement.

Obligations renforcées pour les systèmes à haut risque. Les usages dans des contextes sensibles (information, éducation, emploi) sont soumis à des exigences de documentation et d’audit plus strictes.

Pour une marque qui produit des contenus avec des avatars IA, des décors génératifs ou des musiques synthétiques : l’obligation de transparence concerne principalement les contenus qui dépeignent des personnes réelles ou qui pourraient être confondus avec des événements réels.

La Californie et l’évolution du droit américain

Le Generative AI Copyright Disclosure Act, proposé en Californie, impose aux entreprises de déclarer les œuvres protégées utilisées pour entraîner leurs modèles. Ce texte n’est pas encore adopté au niveau fédéral, mais il illustre la direction dans laquelle le droit évolue. Les marques qui travaillent pour des clients américains ou diffusent aux États-Unis doivent suivre cette évolution.

Les solutions techniques pour la traçabilité et la transparence

Au-delà de la réglementation, des solutions techniques permettent dès aujourd’hui d’identifier l’origine d’un contenu et de prouver son mode de production.

Adobe Content Credentials. Un système de métadonnées attachées à chaque fichier qui indique qui a créé le contenu, quels outils ont été utilisés et si de l’IA a été impliquée. Compatible avec Photoshop, Firefly et un écosystème croissant de plateformes.

Le watermarking invisible. Des systèmes comme DiffusionShield intègrent un filigrane numérique invisible dans les images originales, reproduit dans les contenus générés à partir de ces images permettant de démontrer un usage non autorisé.

La Coalition for Content Provenance and Authenticity (C2PA). Un standard ouvert, soutenu par Adobe, Microsoft, BBC et Sony, qui définit un protocole commun de traçabilité des contenus numériques. De plus en plus de plateformes de diffusion s’y conforment.

Ce que les marques doivent faire concrètement

La réglementation est en cours de construction. La jurisprudence se précise. Ce n’est pas une raison d’attendre c’est une raison de se positionner maintenant sur des pratiques qui seront bientôt obligatoires.

Quatre actions à intégrer dans les workflows de production de contenu IA.

Vérifier les licences des outils utilisés. Chaque plateforme IA a des conditions d’utilisation commerciale différentes. Cette vérification doit être systématique avant tout déploiement commercial, et les licences conservées dans les archives de production.

Éviter les générations trop proches d’œuvres identifiables. Un style graphique générique est sans risque. Un contenu généré qui ressemble manifestement à une œuvre, un personnage ou un artiste protégé est une exposition judiciaire.

Signaler les contenus générés qui dépeignent des personnes

réelles. Tout contenu utilisant une likeness réelle clone numérique, avatar inspiré d’une personne doit être produit avec un consentement explicite et signalé comme généré par IA.

• Intégrer la traçabilité dans les métadonnées. Utiliser les outils de Content Credentials ou équivalents pour documenter l’origine des contenus produits. C’est une bonne pratique aujourd’hui ce sera une obligation demain.

Le point de vue Infuse-IA

Proposer à un client un contenu génératif sans avoir vérifié les droits des outils utilisés, sans avoir signalé la nature IA des éléments produits, sans s’être assuré de la conformité avec l’AI Act européen c’est lui transférer un risque qu’il n’a pas demandé à porter.

Notre positionnement est celui d’un partenaire qui produit avec discernement : efficacité IA là où elle apporte une valeur réelle, vigilance légale et éthique là où les risques existent. Ce n’est pas la prudence pour la prudence. C’est l’intelligence de production.

Les marques qui travaillent avec nous savent que leurs contenus sont produits dans un cadre maîtrisé. C’est un actif de confiance de plus en plus rare dans un marché où l’accès aux outils IA ne garantit pas la compétence pour les utiliser.

FAQ Droits d’auteur et transparence avec l’IA générative

Un contenu généré par IA est-il protégé par le droit d’auteur ?

Pas automatiquement. Le Copyright Office américain et les cadres juridiques européens exigent une contribution créative humaine pour qu’une œuvre bénéficie d’une protection. Un contenu entièrement généré sans intervention humaine significative n’est pas protégeable. En revanche, un contenu où l’humain apporte une direction artistique, une sélection ou une modification substantielle peut être protégé. La frontière précise reste à stabiliser par la jurisprudence.

Peut-on utiliser n’importe quel outil IA pour produire du contenu commercial ?

Non. Les conditions d’utilisation de chaque plateforme définissent ce qui est autorisé en usage commercial. Certains outils intègrent une licence commerciale dans leur offre payante. D’autres restreignent l’usage commercial ou conservent des droits sur les sorties. Cette vérification est non négociable avant tout déploiement à des fins publicitaires ou de communication.

Qu’est-ce que l’AI Act européen impose concrètement aux producteurs de contenu ?

L’AI Act impose principalement deux obligations pour les producteurs de contenu : signaler clairement les contenus générés ou manipulés par IA lorsqu’ils représentent des personnes réelles ou pourraient tromper le public, et ne pas utiliser de systèmes IA interdits (manipulation subliminale, exploitation de vulnérabilités). Les obligations

Chez Infuse-IA, nous considérons que la maîtrise du cadre juridique et éthique de l’IA générative est une composante de la qualité de production pas une contrainte extérieure.

les plus strictes s’appliquent aux usages à haut risque information, emploi, services publics.

Comment savoir si une image générée est trop proche d’une œuvre protégée ?

Il n’existe pas de seuil de similitude automatique reconnu en droit. La question est celle de la « ressemblance substantielle » est-ce qu’un observateur raisonnable reconnaîtrait dans le contenu généré une œuvre, un personnage ou un style protégé ? Les prompts explicitement basés sur des marques, des personnages ou des artistes identifiables sont les situations les plus à risque.

Un clone numérique d’une personne réelle nécessite-t-il un consentement ?

Oui, sans ambiguïté. Créer un clone numérique réplique vidéo et sonore d’une personne sans consentement explicite de cette personne constitue une atteinte au droit à l’image et potentiellement une violation de données personnelles sous le RGPD. Ce consentement doit être écrit, précis sur les usages autorisés, et conservé comme justificatif. Cette règle s’applique à toutes les personnes y compris les employés de l’entreprise.